- L’effet d’aubaine survient quand une aide finance une action déjà prévue sans modifier la décision.

- La distinction entre effet d’aubaine et additionnalité est cruciale pour évaluer l’impact réel des aides.

- Les aides simples favorisent souvent l’effet d’aubaine par asymétrie d’information et effets de seuil.

- Un bon ciblage et la conditionnalité des versements limitent les effets indésirables et optimisent l’efficacité.

- Mesurer l’effet d’aubaine nécessite un contrefactuel plausible et des indicateurs clairs pour éviter les conclusions hâtives.

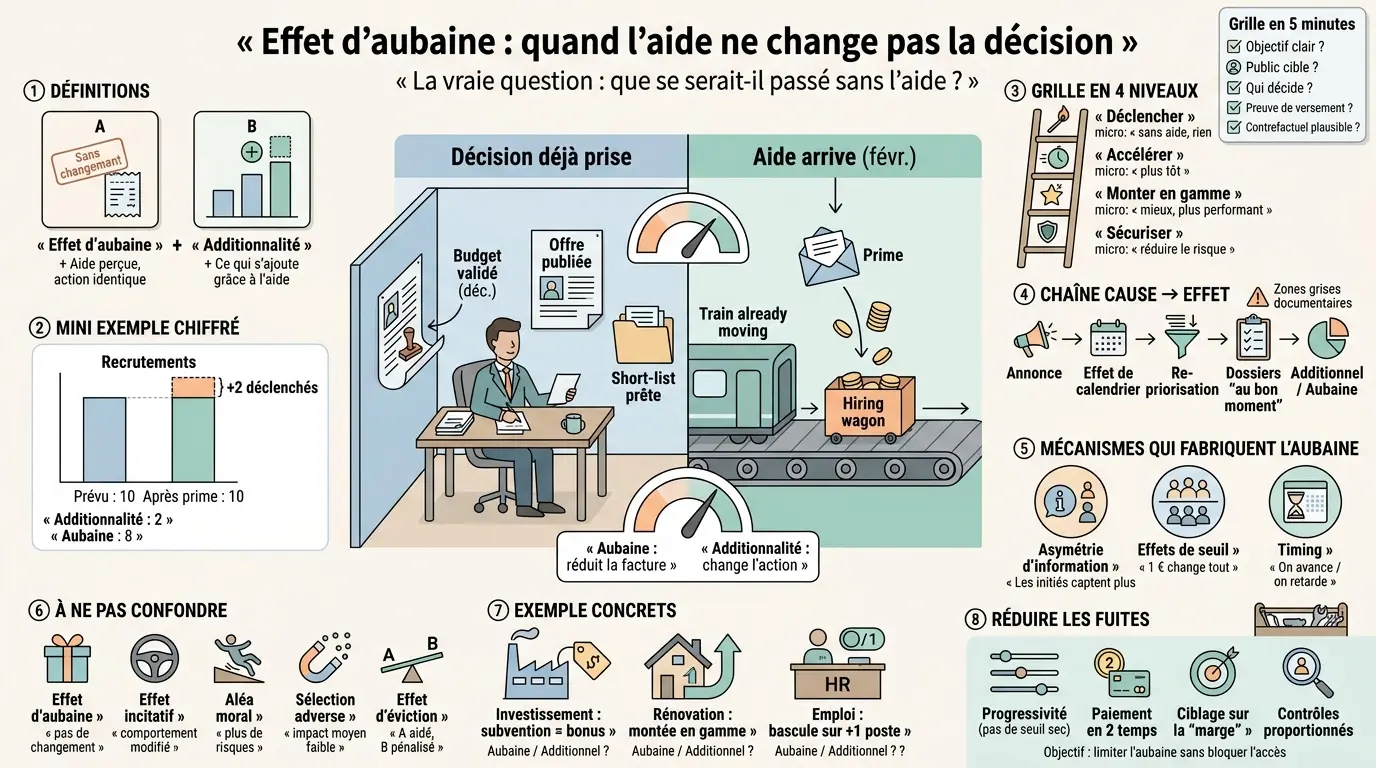

Entre ce que dit une offre d’emploi, ce que comprend un candidat et ce que valide un manager, il y a souvent un décalage très concret à rattraper. Même logique côté aides publiques : l’intention affichée (déclencher des embauches, accélérer la rénovation énergétique, soutenir l’innovation) ne colle pas toujours à la décision réelle sur le terrain. Vous avez peut-être déjà vu le film : une prime sort, tout le monde s’aligne, puis on découvre que beaucoup auraient fait pareil sans aide. C’est là que l’effet d’aubaine entre en scène.

Effet d’aubaine : définition simple, origine et ce que le terme recouvre vraiment

Une fois les mots posés, vous allez voir qu’on parle surtout de décisions qui auraient eu lieu de toute façon, avec ou sans dispositif. Le sujet est moins moral que méthodologique : on cherche à savoir ce que l’aide a réellement changé, au-delà du chèque.

Un cas concret : la prime à l’embauche qui “tombe” sur un recrutement déjà validé

Vous êtes manager en PME, budget de postes bouclé en décembre. En février, une aide à l’embauche arrive pour certains profils, et votre RH vous dit : « Bonne nouvelle, on peut la demander ». Sauf que la décision d’embauche était déjà prise, l’offre déjà publiée, et la short-list déjà prête.

Dans cette configuration, l’aide joue surtout un rôle de bonus budgétaire, pas de déclencheur. Vous captez une subvention parce que vous cochez les cases administratives au bon moment. Ce n’est pas illégal, ni même surprenant : le système est souvent conçu pour être simple d’accès.

Le point sensible se situe ailleurs : si la majorité des bénéficiaires étaient déjà partis pour recruter, le coût budgétaire grimpe sans créer beaucoup d’emplois supplémentaires. Et politiquement, comme économiquement, c’est exactement ce qu’on cherche à éviter quand on parle d’efficacité d’une politique publique.

Définir l’effet d’aubaine et introduire l’additionnalité (le “vrai” effet)

L’effet d’aubaine, c’est quand une aide est perçue sans modifier le comportement du bénéficiaire. L’action financée aurait été réalisée pareil : même projet, même calendrier, même ampleur. L’aide réduit surtout la facture, sans déplacer la décision.

En face, vous avez l’idée d’additionnalité : qu’est-ce qui s’ajoute grâce à l’aide ? Une embauche en plus, un investissement avancé de six mois, une rénovation plus performante. C’est cet écart qu’on veut isoler, même si ce n’est jamais parfaitement observable.

Le nerf de la guerre, c’est un raisonnement contrefactuel : que se serait-il passé sans l’aide ? La réponse n’est jamais parfaite, mais elle structure toute évaluation sérieuse. Et elle évite le piège du « tout est aubaine » dès qu’un dispositif coûte cher.

Le périmètre : aides publiques, subventions, exonérations, crédits d’impôt… même logique

On pense souvent aux primes visibles (« chèque », « bonus », « aide exceptionnelle »). Mais l’effet d’aubaine existe aussi avec une exonération de cotisations sociales, un crédit d’impôt, ou une baisse temporaire de taxe. Le mécanisme reste identique : si cela ne change pas la décision marginale, cela finance surtout ce qui était déjà prévu.

Côté entreprises comme côté ménages, les formes sont variées : subvention, prime à la conversion, soutien à la rénovation énergétique, dispositifs d’innovation. À chaque fois se pose la question du ciblage et du comportement attendu. Qui doit changer quoi, et à quel moment ?

Le sujet revient dans toute politique publique parce qu’il touche au compromis central : être simple pour favoriser le recours (donc dépenser vite), ou être finement ciblé pour limiter les rentes et comportements opportunistes (donc complexifier). La tension est permanente, et rarement confortable.

Effet d’aubaine vs effet incitatif : comment trancher sans se raconter d’histoire

Pour éviter les débats stériles (« ça ne sert à rien » contre « ça aide tout le monde »), il faut une grille de lecture robuste, mais praticable. L’objectif n’est pas de trancher au feeling, mais de qualifier ce que l’aide a vraiment produit.

Une grille en quatre niveaux : déclencher, accélérer, monter en gamme, sécuriser

Posez-vous une question courte : qu’est-ce que l’aide change concrètement ? Sur le terrain, on retrouve souvent quatre effets utiles pour lire un dispositif.

D’abord, le déclenchement : sans aide, rien ne se fait. Ensuite, l’accélération : l’action aurait eu lieu, mais plus tard ; l’aide avance le calendrier. Vient la montée en gamme : on fait mieux grâce à l’aide, par exemple des matériaux plus performants en rénovation énergétique. Enfin, la sécurisation : on réduit un risque perçu, comme tester un profil junior via des aides à l’embauche.

Les deux derniers points sont souvent sous-estimés dans les débats publics. Pourtant ils comptent, notamment en transition écologique ou dans certaines politiques emploi où le risque (technique, financier, RH) freine plus que le coût facial.

Le saviez-vous ? Une mesure peut être incitative sans déclencher plus de volume immédiat si elle améliore surtout la qualité ou réduit les abandons en route. C’est plus difficile à mesurer, mais souvent plus proche du réel.

Ne pas confondre avec aléa moral, rente, optimisation ou effet d’éviction

L’effet d’aubaine n’est pas seul dans la pièce. Il ressemble à plusieurs notions proches, mais qui décrivent des dérives différentes et n’appellent pas les mêmes réponses.

L’aléa moral, c’est quand être couvert par une aide change le comportement… mais dans le mauvais sens : on prend plus de risques parce que quelqu’un paye. La sélection adverse, c’est quand ceux qui ont le plus intérêt privé à capter l’aide sont aussi ceux qui génèrent le moins d’impact public.

La notion de rente décrit plutôt un gain durablement capté par certains acteurs grâce au dispositif (ou au marché), souvent via une asymétrie d’information. Et l’effet d’éviction renvoie à une concurrence déplacée : aider A revient parfois à pénaliser B, qui aurait embauché ou investi sinon.

Enfin, il y a l’optimisation et les comportements opportunistes : jouer avec les règles pour maximiser son gain, légalement (ou à la limite). Cela peut produire de l’aubaine, mais la logique causale n’est pas exactement la même.

| Notion | Définition courte | Exemple | Risque principal |

|---|---|---|---|

| Effet d’aubaine | Aide perçue sans changement de décision | Prime touchée pour une embauche déjà prévue | Coût budgétaire sans impact |

| Effet incitatif | L’aide modifie réellement le comportement | Investissement déclenché grâce au crédit | Dépense utile mais parfois mal ciblée |

| Aléa moral | Protection qui pousse à prendre trop de risques | Projet lancé car « l’État couvrira » | Mauvaise allocation des ressources |

| Sélection adverse | Les bénéficiaires typiques sont ceux avec faible additionnalité | Aide captée par des acteurs déjà très performants | Impact moyen faible |

| Effet d’éviction | Soutien à certains au détriment des autres | Subvention qui déplace des clients vers un acteur aidé | Distorsion et pertes chez les non-aidés |

Après ce tableau, retenez surtout ceci : un même dispositif peut être très incitatif pour certains publics et très « aubainier » pour d’autres. Tout se joue dans la segmentation réelle, pas dans les intentions.

Les effets secondaires qu’on oublie vite : redistribution et concurrence

Quand une aide est large et simple, elle redistribue forcément vers ceux qui savent déposer vite et cocher les cases. Une asymétrie d’information apparaît alors, souvent silencieuse, entre initiés et non-initiés. Elle peut suffire à expliquer une partie des écarts de recours.

Deuxième effet secondaire classique : la distorsion de concurrence. Si deux entreprises ont des structures différentes (taille, capacité administrative), celle qui capte mieux les aides améliore ses marges ou ses prix. Une rente relative peut se créer, sans que personne n’ait triché.

Troisième angle rarement assumé : certaines politiques publiques acceptent volontairement un peu d’aubaine pour aller vite ou frapper fort sur un secteur prioritaire (transition écologique, par exemple). La vraie question devient alors proportionnelle : combien coûte chaque unité supplémentaire produite ?

Les mécanismes qui fabriquent l’aubaine : information, seuils et calendrier

Derrière chaque dispositif, il y a une mécanique assez prévisible. Quand on la voit clairement, on repère mieux où cela va « fuir », et pourquoi certains effets indésirables reviennent si souvent.

De l’annonce au comportement opportuniste : petite chaîne cause → effet

Tout commence avec une annonce officielle ou médiatique. Les acteurs la traduisent ensuite en arbitrages concrets, comme dans un budget personnel : « si je peux récupérer 3 000 €, je décale mon achat », ou au contraire « j’accélère avant que ça s’arrête ». Le signal public devient un signal de calendrier.

Les entreprises font pareil sur leurs investissements et recrutements. Elles re-priorisent des projets déjà listés dans leur entonnoir interne (« à faire », « à étudier », « abandonné ») selon ce que finance maintenant la puissance publique. On n’invente pas toujours un projet : on le remet en haut de pile.

Puis vient une capture partielle, presque inévitable : certains dossiers sont vraiment additionnels, beaucoup sont juste rendus moins chers, et quelques-uns sont requalifiés artificiellement pour entrer dans les critères. En pratique, ce qui bloque souvent ici, c’est moins la fraude que les zones grises documentaires.

Asymétrie d’information et sélection adverse : ceux qui savent jouent mieux

Une aide simple sur le papier reste souvent compliquée dans ses preuves. Résultat : ceux qui maîtrisent mieux les règles captent davantage, qu’il s’agisse de directions financières rodées, de cabinets spécialisés ou de fournisseurs capables de monter des dossiers standardisés. L’accès au dispositif devient un avantage en soi.

C’est là que naît une asymétrie forte : le ménage ou la TPE ne sait pas toujours quels documents déclenchent quoi. Il abandonne, ou passe après tout le monde. Pendant ce temps, ceux qui ont du temps administratif optimisent proprement leur taux de recours.

La sélection adverse arrive vite : parmi tous ceux qui sont éligibles, ceux dont le projet était déjà mûr déposent immédiatement. Ils remplissent mécaniquement les quotas du dispositif, puis on conclut trop tôt au succès parce que « ça marche fort ». Sauf que « fort » ne veut pas dire « incitatif ».

Effets de seuil : quand 1 euro change tout

Les effets de seuil créent presque automatiquement des comportements opportunistes, parfaitement légaux. On reste sous un plafond, on fractionne un projet, on retarde une signature, on modifie légèrement un salaire proposé pour passer sous ou au-dessus du critère. Le design produit le comportement.

Côté RH, c’est très visible avec certaines aides liées au niveau de rémunération ou à des catégories spécifiques. Côté ménages, c’est la même chose avec les revenus fiscaux ou la performance énergétique minimale attendue après travaux. Le seuil devient un objectif, parfois plus que le résultat.

Un seuil net produit aussi des injustices perçues : deux situations quasi identiques reçoivent des montants très différents parce qu’un paramètre bascule au mauvais moment. Et là, vous tenez un cocktail classique : incompréhension, optimisation, défiance envers la politique publique.

Timing et effets d’annonce : avancer ou retarder pour rentrer dans les cases

Le calendrier fabrique lui aussi sa part d’aubaine. Une aide annoncée six mois avant sa mise en œuvre encourage parfois à attendre (« je signe après ») plutôt qu’à agir maintenant. À l’inverse, une fin annoncée déclenche une précipitation : « je lance avant ».

Dans certaines rénovations énergétiques, on voit clairement ces vagues : commandes concentrées sur quelques semaines, puis creux massif ensuite. Le volume total annuel bouge peu ; il est surtout re-timé autour du guichet public. Autrement dit, on déplace plus qu’on ne crée.

Côté entreprises, même logique avec l’investissement productif ou l’innovation : on cale son dossier sur la fenêtre fiscale plutôt que sur sa logique industrielle optimale. C’est rationnel individuellement, mais cela complique fortement toute évaluation d’impact.

Exemples concrets : aides, fiscalité et subventions côté entreprises et ménages

Les exemples parlent mieux quand on chiffre simplement ce qui était prévu, versus ce qui a réellement été déclenché. On voit alors vite si l’aide agit comme levier, comme accélérateur, ou comme simple réduction de coût.

Aides à l’embauche et apprentissage : où se niche vraiment l’aubaine

Prenez une prime liée aux contrats signés avec certains publics (jeunes, demandeurs d’emploi de longue durée, etc.). Si votre besoin opérationnel existe déjà et que votre plan prévoit trois recrutements juniors cette année, vous allez probablement signer ces contrats quoi qu’il arrive. L’aide devient alors une ligne de budget en moins, pas une décision en plus.

Elle peut toutefois être incitative si elle change qui vous recrutez ou comment vous sécurisez votre décision. Par exemple, convertir deux stages non budgétés en apprentissage grâce au soutien financier. Dans ce cas, l’additionnalité est partielle, mais elle est bien réelle.

En pratique, ce qui bloque souvent, c’est que la preuve du caractère additionnel n’existe presque jamais dossier par dossier. On observe donc surtout via des statistiques agrégées : volumes signés, profil des bénéficiaires, durées maintenues après la période initiale. C’est imparfait, mais utile pour éviter les conclusions hâtives.

Rénovation énergétique : inflation des prix et captation par intermédiaires

Sur certaines périodes, des subventions généreuses ont coïncidé avec des hausses tarifaires chez certains artisans ou plateformes. Pas forcément par malveillance : la demande explose alors que l’offre est limitée. L’aide augmente alors autant les prix que les rénovations effectives, ce qui brouille l’impact.

Autre point délicat : qui encaisse réellement l’avantage ? Parfois c’est bien le ménage, via une baisse nette du reste à charge. Parfois c’est partiellement capté par le fournisseur sous forme de marge accrue. On se rapproche alors d’une rente induite par le design public.

Et selon votre statut, l’incitation n’agit pas pareil : propriétaire occupant capable d’avancer la trésorerie, accès facilité ; propriétaire bailleur, arbitrage rendement et contraintes ; locataire, dépendance totale aux décisions du bailleur. Le dispositif est identique, mais la décision n’est pas au même endroit.

Crédit d’impôt innovation ou investissement : additionnalité difficile mais pas impossible

Un crédit d’impôt vise souvent l’innovation ou l’investissement productif. Problème classique : beaucoup déclarent des dépenses de R&D déjà structurées depuis longtemps. Si l’avantage fiscal n’augmente pas l’effort réel, on se rapproche d’un effet d’aubaine.

Mais il existe un contre-exemple fréquent : une PME hésite entre internaliser une compétence technique ou sous-traiter au minimum. Un crédit peut faire basculer vers l’internalisation, donc vers du capital humain durable. Ici, l’effet est plutôt une montée en gamme qu’un simple volume.

Quand vous calculez le net à payer, vous partez du brut, vous retirez les cotisations salariales, puis vous appliquez le prélèvement à la source sur le net imposable. C’est ce dernier point qui explique pourquoi deux bruts identiques peuvent donner des nets différents. Et au quotidien, cela se voit très vite : dès l’onboarding, les mêmes choix se répercutent immédiatement.

Trois mini-scénarios chiffrés : projet budgété vs projet déclenché

Scénario A (entreprise) : investissement machine prévu 100 k€. Subvention 20 k€ obtenue sans changer ni modèle ni timing. Impact additionnel proche de 0 ; coût public 20 k€ ; bénéfice privé : marge améliorée.

Scénario B (ménage) : rénovation prévue 10 k€ pour un confort minimal. Aide conditionnée poussant vers une solution plus performante coûtant 14 k€, aide 3 k€. Additionnalité : montée en gamme (+4 k€ de travaux) ; coût public 3 k€ ; externalité positive possible via CO₂ évité.

Scénario C (emploi) : entreprise hésitant entre 0 ou +1 embauche support. Prime annuelle équivalente à environ 30 % du coût chargé pendant six mois faisant basculer la décision. Additionnalité : +1 poste ; risque ensuite : arrêt après la durée minimale si la conditionnalité est faible.

Pour mieux comprendre les enjeux liés à la fiscalité, notre article sur Adelphe et ses obligations peut vous être utile.

Mesurer et identifier : méthodes d’évaluation, indicateurs et limites

Mesurer correctement revient surtout à reconstruire « ce qui se serait passé sinon », sans inventer une histoire confortable après coup. L’exercice est exigeant, mais il évite de confondre un effet d’annonce avec un effet réel.

Une méthode pas-à-pas pour approcher l’additionnalité

Commencez par écrire noir sur blanc l’objectif opérationnel du dispositif en une phrase. « Augmenter les embauches durables », « accélérer la rénovation énergétique », « stimuler l’innovation » ne veulent rien dire tant qu’on ne précise pas pour quel public et avec quel résultat mesurable. Sans cette base, tout le reste flotte.

Ensuite vient le cœur du sujet : construire un contrefactuel plausible, c’est-à-dire un scénario crédible « sans aide ». Vous comparez quoi exactement : les mêmes acteurs avant et après, des bénéficiaires versus des non-bénéficiaires similaires, ou deux zones géographiques proches dont seule l’une reçoit l’incitation ? Ce choix conditionne la solidité de la conclusion.

Terminez par trois indicateurs maximum au départ. Trop mesurer tue souvent la lecture politique comme managériale du résultat ; mieux vaut un indicateur principal et deux garde-fous. Par exemple : volume, maintien, et coût moyen par impact constaté.

Vous vous demandez peut-être quel document déclenche quoi ici ? Typiquement, la chaîne est simple : règles publiées, critères, données disponibles, méthode choisie, puis conclusions possibles. Et chaque maillon limite celui qui suit.

Avant/après, groupes témoins, quasi-expériences : ce que chaque approche permet vraiment

La comparaison avant/après est tentante parce qu’elle est simple : on regarde si quelque chose augmente après le lancement. Mais elle confond facilement dispositif et contexte macroéconomique ; croissance, taux d’intérêt, prix de l’énergie peuvent expliquer autant, voire plus, que la mesure elle-même. On obtient vite un résultat, pas forcément une causalité.

Les groupes témoins sont plus solides : comparer des publics exposés versus non exposés permet de mieux isoler l’effet incitatif. Dans certains cas, on utilise même un tirage au sort ou des règles administratives quasi-aléatoires ; c’est rare, mais très puissant quand c’est possible. Le coût, lui, se situe souvent dans la donnée et la mise en œuvre.

Entre les deux, il existe toute une boîte quasi-expérimentale : différence-de-différences (on suit deux groupes dans le temps), discontinuités autour d’un seuil (effet mesuré juste autour d’un plafond). Ces méthodes réduisent les biais, mais demandent des données propres et des règles stables dans le temps.

Et oui, il restera toujours du débat. Dès qu’un secteur s’adapte stratégiquement, les acteurs anticipent les mesures et modifient leur comportement avant la date de début. Cela brouille la lecture « pure » du traitement, même avec de bons outils.

Indicateurs actionnables pour repérer aubaine et effets pervers

Un premier indicateur souvent parlant est le taux de recours et sa dynamique. Une vague massive dès l’ouverture, puis un effondrement, suggère souvent des effets de calendrier plus qu’un changement durable de comportement. Cela ne prouve rien seul, mais c’est un signal.

Deuxième angle utile : la concentration des bénéficiaires. Si les 5 % du haut captent une part disproportionnée de la subvention ou du crédit d’impôt, vous suspectez soit un bon ciblage sur de gros investisseurs, soit une rente administrative liée à l’asymétrie d’information. Il faut alors regarder qui est censé être « au cœur » du dispositif.

Troisième signal fort : des effets de seuil visibles dans les distributions. Des dossiers « collés » juste sous un plafond de salaire, de revenu ou de performance énergétique révèlent une optimisation rationnelle. Ce n’est pas scandaleux ; c’est instructif sur le design.

Enfin, une métrique pragmatique force souvent le débat à devenir concret : le coût par unité d’impact. Par embauche maintenue X mois, par tonne de CO₂ évitée estimée, par euro investi additionnel. Le chiffre sera discuté, mais il oblige à parler d’arbitrages plutôt que de slogans.

Les limites réelles : biais, données incomplètes et effets de long terme

Le biais numéro un s’appelle biais de sélection. Ceux qui demandent une aide ne sont pas tirés au hasard ; ils sont souvent plus organisés, mieux informés, ou déjà motivés. Résultat : on surestime facilement l’impact si on compare naïvement les bénéficiaires à la population moyenne.

Deuxième limite fréquente : des données administratives incomplètes ou mal appariées. On sait combien de dossiers ont été déposés, mais on observe moins bien ce qui se passe deux ans plus tard : maintien dans l’emploi, performance énergétique réelle après travaux, effets d’apprentissage. L’impact réel se joue souvent après la période de versement.

Troisième difficulté, plus subtile : les changements macroéconomiques prennent toute la place. Inflation, crise énergétique, hausse des taux transforment les arbitrages budgétaires ; isoler l’effet causal devient plus dur que prévu. Et pourtant, c’est précisément quand l’environnement bouge que l’État lance le plus d’aides.

Enfin, il y a le long terme. Un dispositif peut créer de l’apprentissage organisationnel (structurer un processus RH) ou, au contraire, de la dépendance (attendre la prochaine prime). Ces externalités positives ou négatives dépassent souvent l’horizon politique court, mais elles comptent dans l’efficacité réelle.

Réduire les effets indésirables : ciblage, conditionnalité et contrôles proportionnés

On ne supprime jamais totalement l’effet d’aubaine ; on décide combien on accepte, et où l’on met de la friction intelligemment. L’enjeu est de limiter les fuites sans transformer l’accès en parcours du combattant.

Ciblage et publics marginaux : viser là où ça bascule vraiment

Si vous ciblez tout le monde, vous financez surtout ceux qui auraient agi de toute façon. Le levier classique consiste donc à viser la « marge » : les acteurs pour qui la décision est réellement incertaine, parce que la trésorerie est tendue ou le risque perçu élevé. C’est là que l’aide a le plus de chances de faire basculer un choix.

Exemples typiques : TPE avec peu de trésorerie pour investir, ménages modestes pour la rénovation énergétique, employeurs hésitant à recruter un profil junior sans expérience. Dans ces cas, le gain public potentiel est plus grand, parce que la décision n’est pas déjà verrouillée.

Mais attention aux effets secondaires : ciblage fin signifie souvent formulaires complexes, donc exclusion silencieuse des plus petits. Vous retrouvez l’arbitrage : plus c’est simple, plus le recours augmente, mais plus l’aubaine grimpe. Et la question devient très concrète : qui porte la charge de la preuve ?

Conditionnalité des versements et jalons vérifiables

La conditionnalité consiste à attacher l’aide à des actions observables plutôt qu’à des intentions. Cela peut passer par un versement fractionné, des preuves sur factures, le maintien de l’emploi après X mois, ou un niveau de performance atteint après travaux. Le principe est simple : on paie ce qu’on peut vérifier.

Un design fréquent, et souvent efficace, est le paiement en deux temps. Une première tranche à l’engagement, puis une seconde quand le résultat est confirmé (emploi maintenu, travaux certifiés, etc.). Cela réduit l’aubaine pure, parce que les stratégies de « passage éclair » deviennent moins intéressantes.

Cela dit, conditionner trop durement peut tuer l’adoption. Sur le terrain, ce qui bloque n’est pas toujours la mauvaise foi, mais l’incapacité à fournir le bon document au bon moment, surtout pour les indépendants et les petites structures. Une bonne conditionnalité ressemble donc plus à une checklist réaliste qu’à un audit permanent.

Contrôles proportionnés et sanctions crédibles (sans usine administrative)

Contrôler chaque dossier coûte cher et ralentit tout. Les systèmes les plus efficaces combinent souvent un échantillon aléatoire et des contrôles ciblés là où des anomalies apparaissent : seuils systématiques, mêmes pièces partout, intermédiaire unique. On ne cherche pas l’exhaustivité, mais la dissuasion.

Les sanctions comptent moins par leur sévérité que par leur prévisibilité. Si les règles sont claires et l’exécution réelle, les comportements opportunistes reculent mécaniquement, parce que le gain attendu baisse. La crédibilité fait plus que la menace.

Mais l’excès de contrôle a un autre effet pervers : il fait renoncer des acteurs légitimes. PME qui abandonne un crédit d’impôt par peur d’une mauvaise interprétation, ménage qui renonce à une aide à cause du « papier » jugé trop risqué. C’est aussi de l’inefficacité, simplement moins visible.

Leviers concrets de design pour réduire aubaines + seuils cassants

Premier levier simple : la progressivité plutôt que le seuil sec. Au lieu d’une aide entière sous plafond puis zéro au-dessus, on réduit progressivement. Cela limite le « jeu » autour du seuil et atténue l’injustice perçue.

Deuxième levier : des plafonds intelligents et du cofinancement. Une aide en pourcentage, plafonnée en montant, encourage une part de « mise de sa poche » tout en limitant les rentes sur les très gros budgets. On garde un effet incitatif sans subventionner indéfiniment.

Troisième levier : un calendrier stable et prévisible, plutôt que des ouvertures et fermetures surprises. Moins de manipulation du timing, plus de planification réelle. C’est moins spectaculaire politiquement, mais souvent plus efficace économiquement.

Quatrième idée, quand c’est faisable : lier une partie du paiement aux résultats (performance énergétique mesurée, maintien dans l’emploi). Ce n’est pas toujours possible, mais quand ça l’est, cela vise directement l’additionnalité plutôt que les déclarations.

Il est également intéressant de se pencher sur les conséquences du marché noir pour mieux cerner les impacts des aides.

Votre grille de lecture pour juger une aide en 5 minutes (sans tomber dans le “tout est aubaine”)

Avant la critique instinctive (« encore une prime »), prenez cinq minutes avec ces repères. Ils évitent autant la naïveté que le cynisme automatique, et ils ramènent la discussion sur des mécanismes observables.

En cinq minutes, regardez si le dispositif a un objectif clair, une population cible cohérente, et des mécanismes qui limitent l’optimisation sans tuer le recours. Si l’un des trois manque, l’effet d’aubaine a de bonnes chances de dominer le résultat.

D’abord, vérifiez l’objectif réel derrière le wording. Qu’attend-on exactement : plus de volume, meilleure qualité, accélération, sécurisation ? Si rien de mesurable n’est posé, vous ne pourrez pas juger l’efficacité autrement qu’à l’intuition.

Ensuite, identifiez qui capte la valeur en pratique. Est-ce le bénéficiaire final, ou la chaîne de fournisseurs (installateurs, plateformes, organismes de formation) ? Si les fournisseurs ont un pouvoir de marché, une partie de l’aide peut se transformer en hausse de prix plutôt qu’en hausse d’action.

Puis cherchez trois pièges classiques : seuils secs, preuves impossibles pour les petits acteurs, et effets de calendrier. Ces trois ingrédients créent asymétrie d’information, pression à l’optimisation et frustration. Et ce trio alimente ensuite, presque mécaniquement, le récit « tout est aubaine ».

Enfin, posez-vous cinq questions courtes : Qui décide vraiment de faire l’action (ménage, bailleur, manager, direction financière) ? Quel document déclenche le versement (contrat signé, facture, déclaration fiscale, attestation) ? Quel comportement est attendu précisément (déclencher, accélérer, monter en performance, maintenir) ? Quel contrefactuel est plausible : qu’auriez-vous fait sans l’aide ? Où sont les risques majeurs (effet de seuil, aléa moral, sélection adverse, effet d’éviction) ?

Gardez un dernier repère pragmatique : on n’éliminera jamais totalement l’effet d’aubaine. L’enjeu est de savoir s’il reste acceptable au regard de l’impact obtenu et de son coût. Et si vous devez arbitrer une seule protection, choisissez celle qui réduit la plus grosse fuite sans rendre l’accès impraticable : souvent la progressivité ou le paiement fractionné, plutôt qu’une montagne de justificatifs.

Foire aux questions

Qu’est-ce que l’effet d’aubaine dans le contexte des aides publiques ?

L’effet d’aubaine désigne une situation où une aide financière est perçue sans que le bénéficiaire modifie réellement son comportement. Autrement dit, l’action financée aurait eu lieu même sans cette aide, ce qui signifie que le dispositif ne crée pas d’impact additionnel mais réduit simplement le coût pour le bénéficiaire.

Comment distinguer effet d’aubaine et effet incitatif ?

L’effet incitatif correspond à une modification réelle du comportement grâce à l’aide, comme un investissement ou une embauche supplémentaire. À l’inverse, l’effet d’aubaine survient lorsque l’aide ne change pas la décision initiale, elle agit alors comme un simple bonus financier sans générer de volume ou de qualité supplémentaires.

Pourquoi l’effet d’aubaine pose-t-il un problème pour l’efficacité des politiques publiques ?

Parce qu’il génère un coût budgétaire sans impact réel sur les objectifs visés, l’effet d’aubaine limite la rentabilité des dispositifs. Il peut aussi fausser les évaluations en donnant l’impression d’un succès alors que les actions financées auraient eu lieu sans soutien, ce qui nuit à la bonne allocation des ressources publiques.

Quelles méthodes permettent de mesurer l’additionnalité et donc de limiter l’effet d’aubaine ?

Les évaluations sérieuses s’appuient sur des comparaisons avant/après, des groupes témoins ou des quasi-expériences pour estimer ce qui aurait eu lieu sans l’aide. Ces méthodes cherchent à isoler le changement de comportement réel, même si elles restent imparfaites face aux biais de sélection et aux données incomplètes.

Comment réduire les effets indésirables liés à l’effet d’aubaine dans la conception des aides ?

Un ciblage précis vers les bénéficiaires réellement incertains, une conditionnalité basée sur des résultats vérifiables, et des contrôles proportionnés sont des leviers efficaces. Par exemple, un paiement fractionné selon la réalisation d’objectifs réduit les aides perçues sans impact réel, tout en maintenant un accès raisonnable au dispositif.