- Le cherry pick consiste à sélectionner uniquement les données favorables, risquant de déformer la réalité.

- La transparence sur ce qui est exclu est essentielle pour éviter des conclusions biaisées.

- Comparer toujours des données comparables en termes de période, population et définition.

- Le cherry-picking peut fausser les décisions budgétaires, RH ou produit en donnant une image partielle.

- Une check-list simple permet de détecter et réfuter les sélections biaisées sans confrontation.

- En Git, le cherry-pick récupère un commit précis sans fusionner tout l’historique, mais peut générer des conflits.

Entre ce que dit une offre d’emploi, ce que comprend un candidat et ce que valide un manager, il y a souvent un décalage très concret à rattraper. Même chose avec les chiffres. Une équipe pense « pilotage », une autre entend « preuve », et quelqu’un finit par choisir les données qui arrangent pour trancher vite.

Vous voyez le tableau ? Le cherry pick (et son cousin cherry-picking) apparaît souvent là : dans une réunion budget, un reporting RH ou un point produit. L’idée ici est simple : remettre des repères pour détecter, discuter et décider sans se faire embarquer.

Cherry pick : définition, traduction et usages en français

Une expression circule beaucoup parce qu’elle met un mot rapide sur un mécanisme très précis. C’est exactement le cas ici. Elle sert à signaler un tri qui, sous couvert de clarté, peut déformer la réalité.

Et comme elle est devenue courante dans les équipes data, produit ou RH, mieux vaut s’accorder sur ce qu’elle recouvre vraiment. Sinon, on se comprend… de travers.

Définition courte : « cherry pick » vs « cherry-picking »

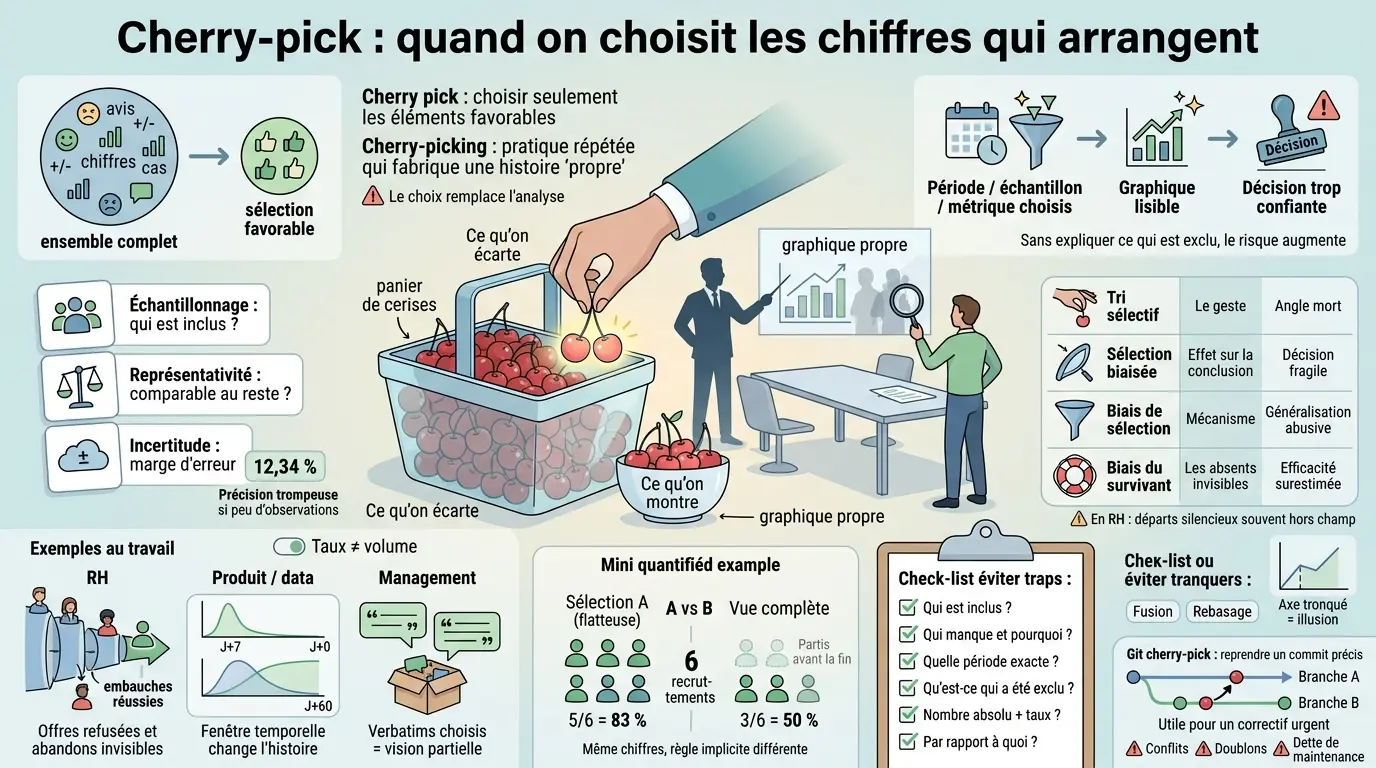

Cherry pick, c’est choisir seulement les éléments favorables dans un ensemble plus large. Cherry-picking, c’est la pratique répétée ou structurée de ce tri sélectif, volontaire ou non, jusqu’à fabriquer une histoire « propre ».

En réunion, ça donne des phrases du type : « On peut regarder uniquement les retours positifs ? » ou « Prenons ce graphique-là, il est plus lisible. » Dit comme ça, tout paraît innocent. Le problème arrive quand le choix remplace l’analyse, et que la sélection n’est ni expliquée ni comparable.

La frontière entre simplifier et manipuler tient souvent à une question très simple : qu’est-ce qui a été écarté, et pourquoi ? Tant que cette réponse reste floue, le risque de conclusion bancale augmente.

Origine anglaise et raisons de l’usage en français

L’image vient de la cueillette : on prend les meilleures cerises du panier. En entreprise, le terme reste utilisé parce qu’il est plus court que « sélection biaisée » et parce qu’il suggère une intention implicite : on ne résume pas, on choisit.

Autre raison très terre à terre : les équipes produit et data travaillent avec beaucoup de documentation en anglais. Elles importent donc naturellement le vocabulaire dans les rituels internes, comme les revues de métriques, les analyses d’expériences ou les comités de pilotage.

Et parfois, oui, c’est aussi du jargon pour aller vite. Dire « attention au cherry-picking » évite un débat de dix minutes sur la méthodologie. Pratique, mais seulement si tout le monde met la même chose derrière le mot.

Synonymes proches : tri sélectif, sélection biaisée, biais du survivant

On confond souvent plusieurs notions qui se ressemblent mais ne racontent pas la même histoire. Le tri sélectif décrit l’acte de choisir ; la sélection biaisée décrit plutôt l’effet sur votre conclusion ; le biais de sélection insiste sur le mécanisme statistique ; le biais du survivant pointe un cas particulier où vous n’observez que ceux qui « restent ».

La nuance clé ? L’intention n’est pas toujours consciente. Un manager peut cherry-picker sans chercher à manipuler : il veut juste décider vite, avec des éléments rassurants et faciles à défendre.

Pour clarifier d’un coup d’œil :

| Terme | Ce que ça décrit | Intention typique | Exemple simple | Risque principal |

|---|---|---|---|---|

| Tri sélectif | Le geste de choisir | Variable | Ne montrer que 3 cas | Angle mort |

| Sélection biaisée | L’effet sur l’analyse | Souvent involontaire | Échantillon non représentatif | Décision fragile |

| Biais de sélection | Le mécanisme statistique | Non intentionnel possible | Cohorte mal définie | Généralisation abusive |

| Biais du survivant | Les absents sont invisibles | Très fréquent | Étudier seulement ceux qui réussissent | Surestimer l’efficacité |

Le saviez-vous ? Dans les entreprises qui grandissent vite, le biais du survivant est presque automatique en RH : on parle beaucoup des gens « qui ont tenu », rarement des départs silencieux.

Le biais de sélection en pratique : pourquoi ça raconte une histoire trompeuse

Le piège n’est pas le chiffre en lui-même. Le vrai problème, c’est la chaîne complète entre le choix des données, la manière de les montrer et la certitude affichée ensuite.

Autrement dit : on ne ment pas forcément, mais on peut se tromper avec aplomb. Et ce décalage-là coûte cher.

La chaîne cause → effet : échantillon → graphique propre → décision trop confiante

Ça commence souvent par un réglage discret : la période, l’échantillon ou la métrique retenue. Ensuite, on obtient un graphique lisible, avec deux courbes bien séparées. Et arrive la phrase fatale : « Donc on sait que… »

Sauf que vous ne savez pas toujours. Vous avez surtout optimisé ce qui est montrable dans le temps imparti, avec ce qui tombe sous la main. C’est humain, et c’est précisément pour ça qu’il faut des garde-fous.

Le risque concret ? Une décision budgétaire ou organisationnelle prise avec trop de confiance. Puis, six semaines plus tard, retour à la case départ parce que, dans la vraie vie, l’effet n’était pas stable.

Échantillonnage, représentativité et incertitude (sans se noyer)

Dès qu’on parle statistiques ou indicateurs RH, trois mots font gagner du temps : échantillonnage, représentativité, incertitude. L’échantillonnage répond à « qui est inclus ». La représentativité répond à « est-ce comparable au reste ». L’incertitude répond à « à quel point je peux me tromper ».

Dans beaucoup de reportings internes, l’incertitude disparaît complètement. On affiche un taux à deux décimales comme si c’était gravé dans le marbre. Dans les faits, c’est souvent un habillage propre posé sur peu d’observations.

Et puis il y a le biais du survivant : vous analysez ceux qui sont encore là (clients actifs, salariés présents), mais pas ceux qui ont quitté avant d’être mesurés. Exemple typique en RH : les départs en période d’essai, justement la phase où la rupture est simplifiée sous conditions. Votre image devient mécaniquement flatteuse.

Cherry-picking vs biais de confirmation vs p-hacking

Trois cousins reviennent partout dès qu’on discute preuves et décisions rapides. Le cherry-picking, c’est choisir ce qu’on montre (ou ce qu’on regarde). Le biais de confirmation, c’est chercher activement ce qui conforte une croyance déjà installée (« je savais que cette source marche mieux »). Et le p-hacking, c’est tester plein d’angles jusqu’à tomber sur un résultat « significatif ».

On peut faire du p-hacking sans mauvaise foi apparente. Vous changez plusieurs fois la fenêtre temporelle (« sur 7 jours », puis 30 jours), puis vous passez d’un volume à un taux (« c’est plus parlant »), puis vous excluez deux valeurs extrêmes (« elles faussent tout »). À force d’ajustements opportunistes, vous fabriquez votre preuve.

Micro-détail utile : corrélation n’égale pas causalité. Une corrélation décrit deux phénomènes qui bougent ensemble ; une causalité dit que l’un provoque l’autre. Beaucoup d’arguments fragiles naissent exactement là.

Micro-aparté terrain : l’absence de base de comparaison

En pratique, ce qui bloque souvent, c’est l’absence du fameux « par rapport à quoi ? ». Sans référence (historique stable, comparaison interne cohérente), on juge sur une impression déguisée en métrique.

Vous avez déjà entendu « on a progressé » sans savoir si c’était +2 points sur 10 000 événements ou +2 points sur 20 ? Voilà. Sans base solide ni comparaison pertinente (même périmètre, même saisonnalité), votre cerveau comble les trous avec du storytelling.

Quand vous sentez ça arriver en réunion, revenez au concret : même période N-1 ? même population ? même définition ? Ça remet les pieds au sol sans humilier personne.

Exemples au travail : quand le tri sélectif s’invite dans vos chiffres et vos réunions

Le cherry pick ne se limite pas aux équipes data. Il vit très bien dans des comités RH, des points hebdo opérationnels, et même dans des arbitrages du quotidien où tout le monde est pressé.

Le plus piégeux, c’est qu’il peut ressembler à du bon sens : « on va à l’essentiel ». Sauf que l’essentiel, sans cadre, devient vite « ce qui arrange ».

Côté RH : recrutements « réussis », abandons invisibles et effets secondaires

Cas classique en recrutement opérationnel : on présente uniquement les embauches réussies (« regardez ces trois profils top »). On oublie les offres refusées et les candidats perdus au milieu du processus. Résultat : vous surestimez votre attractivité et vous sous-estimez la friction côté candidat.

Même mécanique pendant l’onboarding : on suit le taux de complétion des formations pour ceux qui sont encore là à J+30, mais on ignore ceux partis avant J+30 parce qu’ils n’apparaissent plus dans les tableaux. Votre programme semble solide alors qu’il filtre simplement ceux qui accrochent déjà.

Et côté rémunération, l’effet est moins visible mais tout aussi réel. Si vous ne regardez que les salaires des personnes restées deux ans (biais du survivant), vous risquez d’ancrer votre grille trop haut ou trop bas selon votre turnover réel par population.

Côté produit/data : cohorte gagnante, fenêtre temporelle tronquée et métriques interchangeables

Dans une équipe produit, cherry-picker ressemble souvent à ceci : prendre la cohorte où ça marche (nouveaux utilisateurs acquis via tel canal) puis généraliser au reste, alors que leur usage est différent dès J1. Sur le papier, la conclusion est séduisante ; sur le terrain, elle casse.

Deuxième grand classique : jouer avec la fenêtre temporelle. Sur 7 jours post-lancement, votre fonctionnalité cartonne ; sur 60 jours, elle plafonne, parce qu’elle concerne surtout des utilisateurs très enthousiastes au début puis moins actifs ensuite. Selon la fenêtre, vous ne racontez pas la même histoire.

Troisième levier très tentant : changer la métrique quand ça arrange (taux vs volume). Un taux peut monter pendant que le volume baisse si votre base se réduit fortement. Visuellement, ça fait joli ; opérationnellement, ça peut annoncer un problème de chiffre d’affaires ou de charge support.

Côté management : verbatims choisis et décisions budget/staffing/primes

Deux verbatims positifs issus d’une enquête interne, un graphique flatteur sorti d’un outil RH ou finance, et la décision est prise sur les primes ou le staffing du trimestre. Sur le papier, c’est rationnel ; dans les faits, c’est parfois juste une sélection confortable, faute de temps pour regarder tout le spectre.

Selon votre statut, les effets secondaires changent vite. Côté salarié ou manager intermédiaire, vous pouvez subir une cible irréaliste basée sur des chiffres partiels (« l’équipe X y arrive »). Côté indépendant ou consultant payé au livrable ou au jour-homme, une présentation cherry-pick peut servir à renégocier votre périmètre sans renégocier votre prix.

Côté dirigeant, enfin, vous portez aussi le risque juridique et social quand des décisions RH s’appuient sur des critères mal documentés. Une promotion contestée, une logique floue, et la donnée mal cadrée finit en conflit humain très concret.

- « Prenons uniquement le dernier mois. »

- « Ce segment est atypique donc on l’enlève. »

- « Regardez plutôt ce taux-là. »

- « Les exceptions ne comptent pas. »

Pour mieux comprendre les enjeux de sélection dans le monde professionnel, explorez notre article sur la notion de partie prenante et son impact sur les décisions.

Détecter et réfuter un argument fallacieux : la check-list qui évite de se faire embarquer

Vous n’avez pas besoin d’être statisticien pour éviter une manipulation des données. Le plus efficace, c’est d’installer quelques questions réflexes, comme une check-list avant départ.

L’objectif n’est pas de piéger quelqu’un. C’est de sécuriser une décision, surtout quand elle engage du budget, des personnes ou du temps.

Check-list opérationnelle côté graphiques et chiffres

Commencez par vérifier ce que vos yeux avalent trop vite dans une visualisation. Un axe tronqué suffit parfois à créer une illusion énorme, sans mentir techniquement.

Avant de valider un « +X % », revenez à quelques points simples : l’axe vertical part-il bien de zéro (et si non, pourquoi) ? Les unités sont-elles cohérentes (euros vs milliers d’euros) ? La taille d’échantillon est-elle claire (12 cas ou 12 000) ?

Ensuite, interrogez le cadre : la période choisie est-elle justifiée (semaine atypique, saisonnalité) ? Les données exclues sont-elles listées (valeurs extrêmes retirées) ? Et surtout, compare-t-on vraiment des choses comparables (même définition, même périmètre, même contexte) ?

Un détail compte aussi : si tout tient dans une seule diapo trop parfaite, demandez-vous où sont passés les angles morts. En général, ils existent ; ils sont juste hors champ.

Exemple chiffré simple : deux sélections opposées sur le même sujet

Prenons un sujet RH banal : mesurer si un nouveau canal améliore vos recrutements (qualité après période d’essai). Vous avez 20 recrutements récents au total.

Sélection A (présentation flatteuse) : le nouveau canal représente 6 recrutements, et 5 « réussites » après période d’essai. La conclusion affichée est donc 83 %, ce qui donne l’impression d’un canal excellent.

Sélection B (vue complète) : sur ces 6 recrutements, 2 personnes sont parties avant la fin de la période d’essai. Si vous comptez ces sorties comme des non-réussites, il ne reste que 3/6 qui passent vraiment J+90 selon vos critères. Conclusion alternative : 50 %, résultat moyen.

Même base de départ, même sujet, mais une règle implicite différente : inclure ou non ceux partis tôt, autrement dit votre définition opérationnelle de la réussite. Tant que cette définition n’est pas posée, chacun peut « avoir raison » avec les mêmes chiffres.

Ce genre d’écart arrive aussi quand on compare deux offres : un brut identique peut donner un net différent selon les avantages imposables ou non, et selon le prélèvement à la source. Dans le quotidien, on le voit souvent dès l’onboarding : les choix administratifs et fiscaux se répercutent tout de suite.

Réfuter proprement sans attaquer la personne

La meilleure réfutation ressemble rarement à un affrontement frontal (« tu manipules »). Elle ressemble plutôt à une demande structurante : source, périmètre, hypothèses.

Concrètement, demandez l’échantillon complet (et sa taille), puis ce qui a été exclu. Proposez ensuite une comparaison alternative simple (autre période, autre segment) et, au minimum, exigez le duo « nombre absolu + taux » pour éviter les illusions.

Le ton compte autant que vos questions : restez factuel, visez la méthode, pas l’intention supposée. Et oui, parfois quelqu’un cherry-pick juste parce qu’il est pressé, pas parce qu’il manipule sciemment.

- Qui est inclus dans ces chiffres ?

- Qui manque et pourquoi ?

- Quelle période exacte utilisez-vous ?

- Quelle autre métrique raconterait autre chose ?

- Quel contre-exemple connu existe déjà ?

- Qu’est-ce qui invaliderait cette conclusion ?

Git cherry-pick : récupérer un commit sans tout fusionner

Ici, on parle technique pure : même expression, usage différent. Pourtant, l’analogie reste étonnamment bonne. On sélectionne une modification précise, sans embarquer tout le reste.

Et comme en analyse de données, c’est utile… tant que c’est fait avec méthode.

De quoi parle-t-on côté technique : commit, branche, historique

Dans Git, un commit est une modification enregistrée ; une branche est une ligne parallèle d’historique. Fusionner (merge) assemble deux historiques, tandis que rebaser (rebase) réorganise cet historique pour garder quelque chose de linéaire.

Faire un git cherry-pick revient à prendre un commit précis depuis une branche A et à l’appliquer sur votre branche B, sans intégrer tout ce qui l’entoure. Typiquement, c’est utilisé pour un correctif urgent repris de la branche principale vers une version de livraison, pour un retour de correctif vers une version maintenue, ou pour isoler une correction dans une branche longue où tout n’est pas prêt.

On comprend vite pourquoi ça s’appelle ainsi : vous prenez une cerise, pas tout le panier.

Mini-tutoriel : identifier, appliquer, gérer les conflits, tracer l’origine

Le déroulé standard commence par retrouver l’identifiant du commit via l’historique. Ensuite, vous lancez la commande de cherry-pick avec le hachage du commit choisi.

Si Git signale un conflit, vous le résolvez fichier par fichier, puis vous reprenez l’opération avec l’option de continuation. Et si vous réalisez que c’était une mauvaise idée, vous pouvez annuler l’opération avec l’option d’abandon.

Pour garder une trace claire de l’origine de la modification, une option utile ajoute automatiquement, dans le message du commit, une référence au commit d’origine. En audit interne, ce détail évite beaucoup de débats stériles.

Petite réalité terrain : lors des conflits, chacun pense avoir raison. La bonne question devient vite : quelle version correspond vraiment aux attentes métier, sur cette branche-là ?

Risques classiques : doublons, conflits récurrents, dette de maintenance

Cherry-picker plusieurs commits liés crée facilement des incohérences. Vous récupérez la correction A, mais elle dépend implicitement d’un remaniement B non repris. Résultat : tests cassés ou comportement étrange, difficile à expliquer rapidement.

Autre risque très fréquent : les doublons. Si quelqu’un applique ensuite une fusion ou un rebasage ailleurs, Git peut voir passer deux fois une modification presque identique, sous des formes différentes. Bonjour les collisions lors des prochaines intégrations.

Dernier point auquel on pense rarement au début : répéter régulièrement ces opérations devient une dette de maintenance. Chaque nouvelle version doit être reportée à la main, et chaque conflit revient comme une facture mensuelle.

Reliez-le mentalement à votre check-list : sélectionner finement a son intérêt ; sélectionner sans discipline coûte cher.

Quand éviter cette approche : limites risques et alternatives recommandées

Que ce soit dans vos arguments ou dans Git, sélectionner peut dépanner. Le problème commence quand cette sélection devient votre manière habituelle de décider, ou votre méthode par défaut pour « faire passer » des changements.

Vous réduisez déjà beaucoup les risques avec trois réflexes : expliciter ce que vous excluez, garder une trace, et demander systématiquement une comparaison équivalente avant validation finale. Pour sécuriser l’ensemble, mettez en place une revue croisée et une transparence minimale : base complète accessible, définitions figées, hypothèses visibles.

Côté Git, évitez surtout le cherry-pick quand vos modifications sont fortement liées (remaniement massif) ou quand l’historique partagé va multiplier les conflits pour tout le monde. Préférez alors une fusion si vous devez intégrer globalement, un rebasage si vous devez réordonner proprement, une annulation propre pour revenir en arrière, ou un mécanisme de report structuré quand cela devient régulier.

Au fond, c’est toujours pareil : ce que vous choisissez d’inclure pèse souvent plus lourd que le discours final. La prochaine fois qu’une diapo paraît trop nette, posez juste deux questions : « Qu’est-ce qu’on a sorti ? » et « Si je prends toute la base, je vois quoi ? »

Les limites de certaines approches peuvent être éclairées par notre article sur le marché noir, qui illustre des conséquences inattendues.

Foire aux questions

Qu’est-ce que le cherry pick en entreprise et pourquoi ce terme est-il utilisé ?

Le cherry pick désigne la sélection volontaire ou inconsciente d’informations favorables dans un ensemble plus large, souvent pour simplifier ou orienter une décision. Ce terme anglais est adopté en français car il est court, imagé et courant dans les équipes techniques ou data, où il permet de désigner rapidement ce biais sans entrer dans des débats longs sur la méthodologie.

Comment reconnaître un cherry-picking dans un reporting ou une réunion ?

Un cherry-picking se repère souvent quand on remarque des données partielles présentées sans contexte, comme un choix de période atypique, l’exclusion de certains segments ou la mise en avant de métriques flatteuses sans explication. Poser des questions sur ce qui a été écarté ou comparer avec d’autres périodes aide à détecter ce tri sélectif.

Quelle différence entre cherry-picking, biais de confirmation et p-hacking ?

Le cherry-picking consiste à choisir ce qu’on montre, tandis que le biais de confirmation se traduit par une recherche active de preuves qui confirment une idée préexistante. Le p-hacking, lui, implique de tester plusieurs analyses jusqu’à trouver un résultat statistiquement significatif, souvent sans intention malveillante mais au risque de conclusions erronées.

Quels sont les risques concrets du cherry pick dans la prise de décision ?

Le principal danger est de fonder une décision sur une image partielle ou biaisée, ce qui peut conduire à des choix inefficaces ou coûteux, notamment en budget, ressources humaines ou stratégie produit. Cette illusion de certitude masque souvent une incertitude réelle ou des données contradictoires ignorées.

Comment limiter les effets du cherry pick dans l’analyse de données ?

Pour réduire ce biais, il faut systématiquement demander la taille et la composition de l’échantillon, vérifier la période et les critères d’exclusion, et comparer les résultats avec d’autres segments ou périodes. Une transparence sur les hypothèses et une revue croisée des données renforcent aussi la fiabilité des conclusions.