- Une enquête quantitative mesure des comportements, opinions ou usages avec des données chiffrées exploitables.

- Le questionnaire doit être clair, fermé et prétesté pour limiter les biais de compréhension et d’interprétation.

- Le choix du mode de collecte influence fortement la qualité des réponses, du taux de réponse et la représentativité.

- La taille et l’échantillonnage conditionnent la fiabilité des résultats, bien plus que le volume seul.

- L’analyse repose sur les tris à plat, les tris croisés et une restitution sobre pour guider la décision.

- Les biais de collecte, de réponse et de validité peuvent fausser une enquête quantitative malgré des chiffres précis.

Entre ce que dit une offre d’emploi, ce qu’un candidat comprend et ce qu’un manager valide, il y a souvent un écart bien réel à combler. Une enquête quantitative sert justement à remettre de l’ordre dans ce décalage grâce à des chiffres, un protocole clair et une lecture structurée des réponses. Le principe paraît simple, mais les erreurs se glissent vite dans le choix des répondants, la formulation du questionnaire ou l’interprétation des résultats.

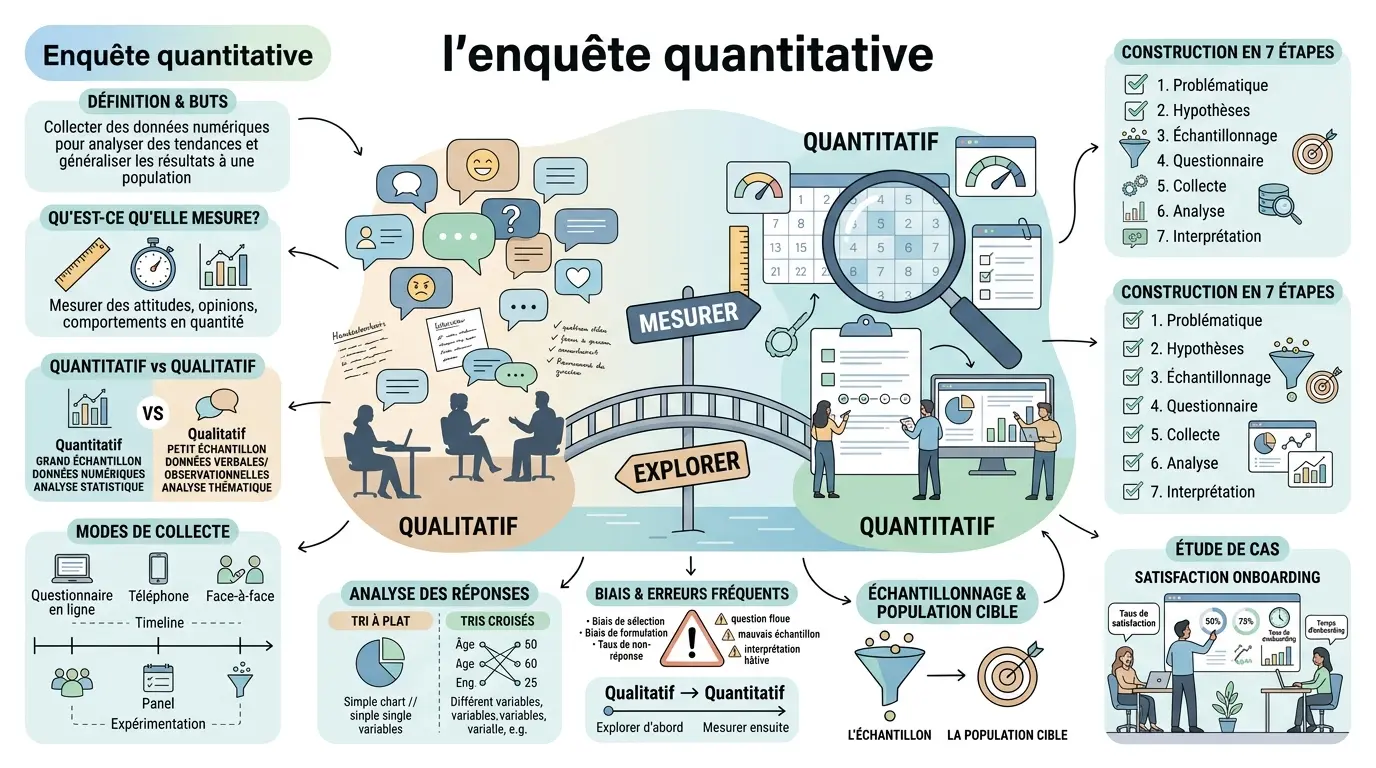

Qu’est-ce qu’une enquête quantitative, au juste ?

Une enquête quantitative repose sur une logique de mesure. On cherche à recueillir des données chiffrées sur une population pour comparer, estimer et, sous certaines conditions, généraliser les résultats.

Une définition simple, sans jargon

Une enquête quantitative sert à compter, classer et mesurer. Vous voulez savoir combien de clients sont satisfaits, combien de collaborateurs utilisent un outil, ou quelle part d’une population adopte une habitude précise. C’est une méthode qui transforme une intuition en indicateurs lisibles, avec une collecte de données pensée pour être analysée.

Le cœur du sujet est là : plus le protocole est clair, plus l’analyse des données est exploitable. Si vous posez une question vague, vous obtenez une réponse floue. Si vous définissez votre périmètre, vos variables et vos options de réponse, vous créez un cadre qui limite les interprétations improvisées.

On croise vite plusieurs termes proches. Une étude quantitative désigne la démarche globale, le questionnaire est l’outil, le questionnaire quantitatif contient surtout des questions fermées, et le sondage renvoie souvent à une collecte rapide sur un échantillon. Dans la pratique, ces mots sont parfois mélangés, mais le mécanisme reste le même.

Vous vous demandez peut-être où commence la différence avec un simple questionnaire de satisfaction. La réponse tient à l’usage des résultats. Un questionnaire peut rester descriptif, alors qu’une enquête quantitative vise une lecture plus cadrée, avec des règles de diffusion, d’échantillonnage et d’analyse statistique.

Ce qu’elle permet vraiment de mesurer

Cette méthode est très utilisée pour la satisfaction client, l’étude de marché, la notoriété, les usages produit ou le climat social. Elle permet aussi de mesurer des comportements, des opinions ou des habitudes à une échelle suffisante pour repérer des tendances. En RH, on la retrouve par exemple sur l’onboarding, l’engagement ou la perception de la rémunération.

Les résultats prennent souvent la forme de pourcentages, de moyennes, d’écarts entre groupes ou de tendances globales. Un tableau bien construit ou un graphique simple peut déjà faire ressortir un signal clair. C’est là que l’outil devient utile : quand vous passez d’une impression à un repère chiffré.

La limite est connue, mais elle mérite d’être dite clairement. Une enquête quantitative vous dit combien, à quelle fréquence et pour qui. Elle dit rarement pourquoi, à elle seule. Pour comprendre les ressorts profonds, il faut souvent ajouter une étude qualitative.

Quantitatif ou qualitatif : quelle question cherchez-vous à trancher ?

Les deux approches ne s’opposent pas. Elles ne répondent simplement pas à la même question, ni avec le même niveau de preuve.

Deux logiques, deux types de preuves

Le quantitatif mesure des volumes et permet de généraliser sous conditions. Le qualitatif explore les motivations, les freins et les mécanismes de décision. Si vous cherchez une estimation robuste, vous allez vers des données quantitatives ; si vous cherchez à comprendre les raisons d’un comportement, vous ouvrez plutôt une enquête qualitative.

Le format, la taille d’échantillon et la forme des questions changent aussi. Un questionnaire fermé peut être envoyé à plusieurs centaines de répondants. Un entretien qualitatif repose au contraire sur peu de personnes, mais avec plus de profondeur. Le livrable n’a pas la même tête : un tableau de résultats d’un côté, des verbatim et une analyse de l’autre.

Le bon réflexe est simple. Si vous devez arbitrer une décision, demandez-vous si vous cherchez une explication ou une estimation. Vous avez déjà une hypothèse ? Le quantitatif la teste. Vous ne savez pas encore ce qui compte ? Le qualitatif vous aide à la faire émerger.

Le bon ordre quand vous combinez les deux

Le séquencement le plus fréquent est assez logique. On commence par du qualitatif pour faire surgir des hypothèses, puis on passe au quantitatif pour mesurer et dimensionner. C’est un peu comme passer d’un croquis à un budget détaillé : d’abord on comprend la forme, ensuite on chiffre.

L’ordre inverse existe aussi. Quand des chiffres surprennent, il faut parfois revenir vers quelques entretiens pour comprendre ce qui se cache derrière un résultat. Une baisse de satisfaction, une rupture de comportement ou un score très bas sur un item précis demandent souvent un complément d’explication.

La méthode mixte évite deux pièges classiques. D’un côté, un questionnaire mal cadré parce qu’on n’a pas assez exploré le sujet en amont. De l’autre, des conclusions trop rapides tirées d’un petit nombre d’échanges. Le saviez-vous ? Beaucoup de projets gagnent surtout en clarté quand on accepte de faire les deux dans le bon ordre.

Choisir le bon mode de collecte avant de diffuser

Le canal de collecte change la qualité des réponses. Le même questionnaire ne produit pas les mêmes effets selon qu’il est diffusé en ligne, par téléphone ou via un panel.

Le questionnaire en ligne quand il faut aller vite

Le sondage en ligne reste le mode d’administration le plus courant. Il est rapide à mettre en place, peu coûteux et simple à exporter pour l’analyse statistique. Quand vous avez besoin d’aller vite sur une population accessible, c’est souvent la solution la plus fluide.

Mais la facilité a son revers. L’auto-sélection est fréquente, les personnes les plus motivées répondent davantage, et l’abandon en cours de route peut faire chuter le taux de réponse. Sur mobile, un questionnaire trop long ou mal lisible fatigue vite. Résultat : la qualité baisse avant même la fin de la diffusion.

Ce format fonctionne bien pour la satisfaction client, un baromètre interne ou une étude d’usages. Il convient aussi quand vous avez déjà une base de contacts et que la population cible utilise facilement le numérique. Là, la vraie question devient : combien de répondants vous perdez entre l’envoi et l’analyse ?

Téléphone, panel : ce que vous achetez vraiment

L’enquête par téléphone garde un intérêt quand la population est moins digitale ou quand vous voulez mieux contrôler l’administration. Vous limitez certains abandons et vous pouvez clarifier une question mal comprise. En pratique, ce mode coûte plus cher et demande davantage de pilotage.

Le panel apporte autre chose : un accès rapide à des répondants qualifiés, souvent avec des quotas par âge, genre ou région. C’est pratique pour une étude de marché ou un test rapide. Mais un panel n’est pas un passe-partout. Si le fournisseur est faible sur le recrutement ou le suivi, la qualité des réponses se dégrade vite.

Le point souvent sous-estimé tient à la représentativité. Un échantillon acheté n’est pas automatiquement représentatif. Il peut être pratique, bien ciblé, même très large, sans pour autant refléter correctement votre population cible. Qui porte la responsabilité de ce choix ? Vous, au moment du cadrage.

| Mode de collecte | Atouts | Limites | Usage fréquent |

|---|---|---|---|

| Questionnaire en ligne | Rapide, peu coûteux, automatisé | Auto-sélection, abandons, biais mobile | Satisfaction, baromètre, usages |

| Enquête par téléphone | Contrôle de l’administration, aide à la compréhension | Coût plus élevé, délai plus long | Populations moins digitales |

| Panel | Accès rapide à des répondants ciblés | Dépendance au fournisseur, risque de biais | Étude de marché, tests rapides |

L’expérimentation pour tester une cause, pas juste un avis

La logique expérimentale change un peu la donne. Ici, on compare des groupes exposés à des conditions différentes pour observer un effet mesurable. On n’interroge pas seulement une opinion ; on cherche une différence entre deux situations.

C’est ce qui distingue une recherche expérimentale d’un simple questionnaire d’opinion. Vous pouvez tester un message, une variation de prix, un parcours modifié ou un format différent. Le résultat vous aide à comprendre ce qui produit un effet, pas seulement ce que les gens déclarent préférer.

Dans le quotidien d’une entreprise, cela peut prendre la forme d’un test A/B sur une offre d’emploi ou d’un formulaire. Un groupe voit une version, l’autre une autre version. Puis vous comparez les réponses, les clics ou les conversions. Simple sur le papier, mais redoutable si les groupes ne sont pas comparables.

Comment construire une enquête quantitative fiable en 7 étapes

Une enquête solide se construit comme une check-list. Chaque étape en amont conditionne la qualité de la collecte, puis de l’analyse des données.

Partir d’une problématique claire, puis poser vos hypothèses

Tout part d’une question de départ. Qu’est-ce qui déclenche l’étude ? Quelle décision doit-elle aider à prendre ? Sans ce point, on fabrique vite un questionnaire fourre-tout qui mélange trois sujets et ne tranche rien.

Ensuite viennent les objectifs de recherche. Trois ou quatre suffisent souvent, s’ils sont précis. Par exemple : mesurer la satisfaction, comparer deux populations, identifier les irritants majeurs, tester une hypothèse sur un changement de parcours. Chaque objectif doit relier une variable observable à une décision possible.

Les hypothèses de recherche servent de fil conducteur. Elles donnent une direction à vos questions fermées, à vos options de réponse et à votre future analyse statistique. Si vous ciblez mal la population cible, vous élargissez trop le périmètre et vous perdez en lisibilité. Si vous la définissez bien, le reste s’aligne.

Taille d’échantillon : combien de répondants vous faut-il ?

La taille d’échantillon dépend de la précision recherchée, de la marge d’erreur acceptable et du niveau de confiance visé. Le trio est simple à retenir : plus vous voulez une estimation précise, plus vous avez besoin de répondants. Pour une grande population, environ 385 réponses donnent souvent une marge d’erreur proche de 5 % à 95 % de niveau de confiance.

Le raisonnement ressemble à un budget. Vous avez une enveloppe, un niveau de précision cible et des contraintes de terrain. Si vous n’avez que 80 réponses, vous pouvez lire une tendance. Si vous voulez comparer plusieurs sous-groupes, l’exigence grimpe tout de suite.

L’échantillonnage compte autant que le volume. Aléatoire simple, stratifié, quotas ou convenance ne produisent pas la même représentativité. Un échantillon stratifié répartit mieux certains profils. Un échantillon de convenance va plus vite, mais il expose davantage aux biais d’échantillonnage.

| Méthode d’échantillonnage | Principe | Avantage | Limite |

|---|---|---|---|

| Aléatoire simple | Tirage au sort dans la population | Forte logique statistique | Difficile à mettre en œuvre |

| Stratifié | Répartition par sous-groupes | Meilleure couverture | Demande une base structurée |

| Quotas | Respect de proportions fixées | Rapide et pratique | Représentativité partielle |

| Convenance | Réponses disponibles | Très simple | Biais élevé |

Un questionnaire fiable se joue à la formulation

Une question doit porter une seule idée. Sinon, vous obtenez une réponse bancale. Les questions fermées fonctionnent bien quand les options de réponse sont neutres, exhaustives et exclusives. C’est la base si vous voulez comparer les réponses sans interprétation bricolée.

Les échelles de Likert sont très utiles pour mesurer un degré d’accord, de satisfaction ou d’adhésion. Vous pouvez aussi utiliser des questions dichotomiques, des choix multiples ou des classements. Le tout doit rester cohérent avec l’objectif, sinon vous collectez des données qui ne serviront pas.

L’ordre des questions joue aussi. Une question peut orienter la suivante, surtout si elle introduit un effet d’amorçage. Le prétest du questionnaire sert à repérer les incompréhensions, les abandons, les branchements mal gérés et la durée réelle de remplissage. Sans ce passage, vous découvrez les problèmes trop tard.

Si votre dispositif passe par le digital, créer des questionnaires en ligne aide à traduire vos hypothèses en formulaire sans introduire de biais évitables.

Analyser les réponses sans noyer le signal dans le bruit

Une fois la collecte terminée, l’enjeu change. Il faut passer des chiffres bruts à une lecture utile, sans surinterpréter chaque écart.

Tri à plat : le premier niveau de lecture

Le tri à plat consiste à lire une question seule, en regardant les fréquences, les pourcentages, les moyennes, les médianes ou les écarts types si nécessaire. C’est le premier réflexe pour voir comment les réponses se répartissent. Vous commencez par décrire, avant de comparer.

Cette lecture fait apparaître des tendances globales, des valeurs extrêmes ou des anomalies. Si une réponse est très concentrée sur un seul choix, cela mérite d’être regardé. Si un item affiche beaucoup de non-réponses, cela peut signaler un problème de compréhension ou de sens de la question.

Un exemple simple aide à éviter les raccourcis. Dire que 62 % des répondants sont satisfaits ne raconte pas la même chose selon que 25 % sont neutres ou que 18 % sont très insatisfaits. Le même pourcentage peut cacher une expérience très polarisée.

Tris croisés : où les écarts deviennent utiles

Les tris croisés comparent les réponses selon une variable comme l’âge, le canal, l’ancienneté ou la catégorie de clients. C’est souvent là que les écarts deviennent vraiment actionnables. Un résultat global peut donner une impression de stabilité, alors qu’un sous-groupe vit l’inverse.

C’est particulièrement vrai en entreprise. Un baromètre peut sembler correct dans l’ensemble, puis révéler une chute de satisfaction chez les nouveaux arrivants ou sur un site précis. La segmentation permet de voir ce que le chiffre moyen masque.

Restez prudent, tout de même. Des effectifs faibles rendent la lecture fragile. Une corrélation ne prouve pas une causalité. Et si vous segmentez trop finement, vous fabriquez du bruit au lieu de produire du sens.

| Lecture | Ce qu’elle montre | Vigilance |

|---|---|---|

| Tri à plat | Répartition globale des réponses | Ne pas surinterpréter un chiffre isolé |

| Tris croisés | Écarts entre sous-groupes | Vérifier les effectifs |

| Analyse comparative | Différences entre périodes ou canaux | Garder le même protocole |

| Visualisation des données | Lecture rapide des tendances | Choisir un graphique lisible |

Restituer les résultats pour aider à décider

Une bonne restitution tient en trois blocs. D’abord, ce que les données montrent. Ensuite, ce qu’elles ne permettent pas d’affirmer. Enfin, ce qu’il faut faire ensuite. Ce cadre évite de transformer chaque écart en certitude.

Les visualisations simples fonctionnent souvent mieux que les effets graphiques compliqués. Histogrammes, barres empilées, tableaux de synthèse, évolution dans le temps : ces formats facilitent la lecture. Le but n’est pas d’impressionner. Le but est de faire comprendre vite.

L’interprétation des résultats demande une discipline minimale. Si un écart est faible, dites qu’il est faible. S’il est solide, dites pourquoi. Et si la donnée est ambiguë, gardez-la comme une hypothèse, pas comme une preuve. La restitution des résultats gagne beaucoup à rester sobre.

Les erreurs qui faussent vos résultats — et un exemple concret

Une enquête peut sembler propre sur le papier tout en restant fragile dans les faits. Les biais de collecte et de réponse font souvent la différence entre une étude utile et un diagnostic trompeur.

Biais de collecte et de réponse : ce qui bloque souvent

Le biais d’échantillonnage survient quand les personnes interrogées ne ressemblent pas assez à la population visée. Le biais de couverture apparaît quand une partie de cette population n’a tout simplement aucune chance de répondre. Le biais de non-réponse, lui, vient du fait que certains profils répondent moins que d’autres.

L’auto-sélection complique encore le tableau. Ceux qui ont un avis très fort participent davantage, ce qui peut gonfler artificiellement certains scores. Les biais de réponse existent aussi : désirabilité sociale, acquiescement, effet de halo ou formulation orientée peuvent pousser les répondants à répondre “comme il faut”, pas comme ils pensent vraiment.

Les parades sont concrètes. Relances ciblées, anonymat clair, quotas, rotation des items, questionnaire plus court, consignes plus neutres. En pratique, ce qui bloque souvent, ce n’est pas la méthode en elle-même, mais un petit défaut répété à chaque étape.

Validité et fiabilité : deux garde-fous différents

La validité pose une question simple : mesurez-vous bien ce que vous prétendez mesurer ? Si vous cherchez la satisfaction mais que vos items mélangent satisfaction, fidélité et facilité d’usage, la mesure devient floue. La validité porte donc sur le sens de l’outil.

La fiabilité regarde autre chose. Si vous répétez la mesure dans des conditions comparables, obtenez-vous des résultats stables ? Une mesure peut être fiable sans être bien ciblée, et inversement. Les deux dimensions sont nécessaires si vous voulez pouvoir généraliser les résultats avec un minimum de confiance.

Ces garde-fous comptent autant que le volume. Un questionnaire très diffusé, mais mal construit, rassure plus qu’il n’éclaire. Vous avez les chiffres. Pas forcément la bonne lecture.

Exemple pas à pas : mesurer la satisfaction d’onboarding

Prenons un cas simple. Une entreprise veut comprendre la satisfaction des nouveaux arrivants à 30 jours. La problématique est claire : repérer ce qui facilite ou freine l’intégration. Les objectifs de recherche peuvent être au nombre de trois : mesurer la satisfaction globale, identifier les points de friction et comparer les résultats selon l’équipe ou le mode d’arrivée.

Le questionnaire quantitatif peut utiliser une échelle de Likert sur plusieurs items : clarté du poste, qualité de l’accueil, accès aux outils, relation avec le manager. La population cible est définie : tous les salariés embauchés depuis un mois sur une période donnée. La diffusion du questionnaire se fait en ligne, avec relance après cinq jours pour améliorer le taux de réponse.

L’analyse commence par un tri à plat. Imaginons 68 % de satisfaits sur l’accueil, mais 22 % de neutres et 10 % d’insatisfaits sur l’accès aux outils. Le tri croisé révèle ensuite que les profils en télétravail sont moins satisfaits sur ce point que les profils sur site. La décision n’est pas de “refaire l’onboarding” au sens vague, mais de corriger un irritant précis. C’est plus utile.

Faire le bon cadrage avant de lancer

Une enquête quantitative démarre toujours par une question précise, pas par un outil de diffusion. Si l’échantillon est bancal, si le questionnaire est flou ou si l’analyse force le trait, le résultat éclaire mal la décision. Gardez la chaîne complète en tête : objectif, population, méthode, questionnaire, contrôle des biais. C’est ce qui permet de produire des données quantitatives vraiment exploitables.

Avant de figer objectifs, variables et segments, créer une carte mentale peut clarifier le périmètre de l’étude et éviter un cadrage trop flou.

Foire aux questions

Qu’est-ce qu’une enquête quantitative ?

Une enquête quantitative est une méthode qui sert à mesurer un phénomène à partir de réponses chiffrées. Elle permet de compter, comparer et dégager des tendances sur une population cible, à condition que le questionnaire et l’échantillon soient bien construits.

Quelle différence entre une enquête qualitative et une enquête quantitative ?

Le quantitatif répond surtout à des questions de volume, de fréquence et de comparaison. Le qualitatif cherche plutôt à comprendre les motivations, les freins ou le sens des comportements. Les deux approches se complètent souvent, car l’une mesure et l’autre explique.

Quels formats de recherche quantitative peut-on utiliser ?

On retrouve plusieurs formes selon l’objectif : sondage en ligne, enquête par téléphone, panel ou logique expérimentale comme un test A/B. Le bon format dépend du temps disponible, du budget et du niveau de contrôle recherché sur la collecte des données. Tous ne donnent pas le même niveau de représentativité.

Comment savoir combien de réponses il faut pour une enquête quantitative ?

La taille d’échantillon dépend surtout de la précision attendue et de la marge d’erreur acceptée. Pour une grande population, quelques centaines de réponses peuvent suffire pour obtenir une tendance solide, mais la qualité de l’échantillonnage reste déterminante.

Pourquoi un questionnaire peut fausser les résultats ?

Des questions ambiguës, un ordre mal pensé ou des options de réponse incomplètes peuvent orienter les réponses sans qu’on s’en rende compte. Les biais de non-réponse, d’auto-sélection ou de formulation pèsent aussi sur la fiabilité des chiffres. Un prétest permet de repérer ces problèmes avant la diffusion.

Comment analyser les résultats d’une enquête quantitative sans se tromper ?

Commencez par lire les résultats globaux, puis comparez les sous-groupes avec des tris croisés. Cette lecture aide à distinguer une tendance générale d’un irritant précis, mais elle ne prouve pas à elle seule une causalité.